摘要:本文主要介绍了RNN(循环神经网络)的前沿进展。随着技术的不断进步,RNN在多个领域取得了显著成果。本文重点介绍了最新的研究成果、技术趋势以及RNN在不同领域的应用前景。这些进展为人工智能的发展提供了有力支持,推动了相关领域的技术进步。

📖 RNN概述 📖

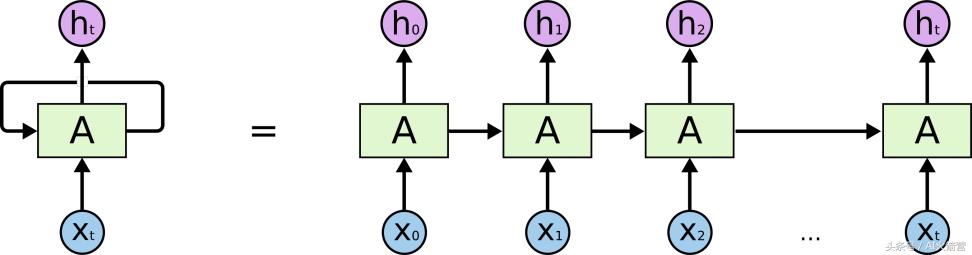

RNN,即循环神经网络,是一种特别适合处理序列数据的神经网络,它通过“记忆”之前的信息来影响当前输出的计算,从而解决了许多传统神经网络难以处理的问题,随着深度学习和人工智能的飞速发展,RNN在各种应用场景中展现出强大的性能,特别是在自然语言处理领域。

🚀 RNN前沿进展 🚀

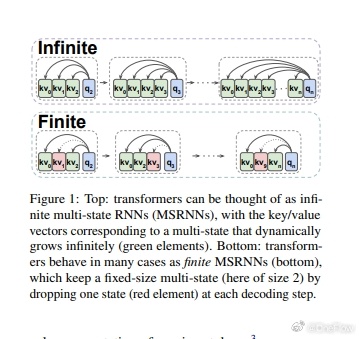

1、Transformer模型及其变体:近年来,RNN的一大突破是Transformer模型的兴起,该模型利用自注意力机制(Self-Attention)处理序列数据,有效捕捉序列中的长期依赖关系,在此基础上,BERT、GPT、T5等模型不断涌现,为自然语言处理领域带来革命性的进步,这些模型现在已广泛应用于图像、语音等多个领域。

2、循环与卷积网络的融合:另一种值得关注的进展是循环神经网络与卷积神经网络的融合,这种融合网络结合了RNN和CNN的优点,既能捕捉序列中的长期依赖关系,又能利用卷积操作提取局部特征,在处理多模态数据时表现出强大的性能。

3、记忆增强型RNN:为了克服RNN在处理长序列时可能出现的梯度消失问题,研究者们提出了如LSTM(长短时记忆网络)和GRU(门控循环单元)等记忆增强型RNN,这些网络结构通过引入“门”机制有选择地传递信息,有效提高了RNN的性能,为处理更复杂、更长的序列数据提供了可能。

4、深度循环神经网络(DeepRNN):通过堆叠多个RNN层,DeepRNN能够捕捉更复杂的序列模式和关系,在处理复杂任务如语音识别、机器翻译等时表现出强大的性能。

5、时空RNN(ST-RNN):时空RNN在视频分析等领域也取得了重要进展,它能够同时处理时间和空间信息,有效捕捉视频中的动态变化,在行为识别、场景理解等方面具有广泛的应用前景。

🌟 🌟

RNN作为自然语言处理领域的核心技术,一直在不断发展与创新,从简单的循环结构到复杂的深度网络,RNN的进步令人瞩目,特别是Transformer模型、循环与卷积网络的融合、记忆增强型RNN以及深度循环神经网络等方向的进展,为处理更复杂、更长的序列数据提供了可能,随着技术的不断进步和应用场景的不断拓展,RNN将在更多领域展现其强大的性能,让我们共同期待RNN的未来发展吧!🚀🚀🚀

希望这篇文章能让你对RNN的前沿进展有更深入的了解,如果你有任何疑问或想法,欢迎在评论区留言交流,让我们共同探讨这个充满潜力的领域!也欢迎你关注我们的后续文章,以获取更多关于人工智能和机器学习的最新资讯和深度解析。#RNN前沿进展 #自然语言处理 #深度学习 #人工智能时代

还没有评论,来说两句吧...